Sommaire

Messages de haine et réseaux sociaux : la difficulté de la modération

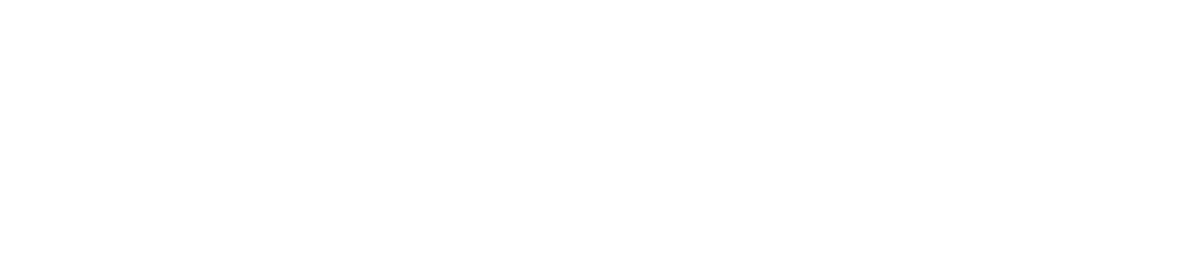

Trigger Warning: des propos et insultes racistes et homophobes se trouvent illustrés dans cet article

La problématique de la modération en ligne devient un débat de société de plus en plus complexe et important. L'achat de Twitter par Elon Musk a encore plus mis en lumière cet épineux problème. Pour autant, il est extrêmement compliqué de modérer ce contenu à propos de pas mal de problématique. Pour ce faire, Saper Vedere avait mené une étude sur les mots-clés haineux envers tout un certain nombre de minorités. Sur un corpus de 140 161 tweets réduits après différents filtres (voir méthodologie) à 10 861 tweets uniques.

L'étude révélait d'importantes conclusions :

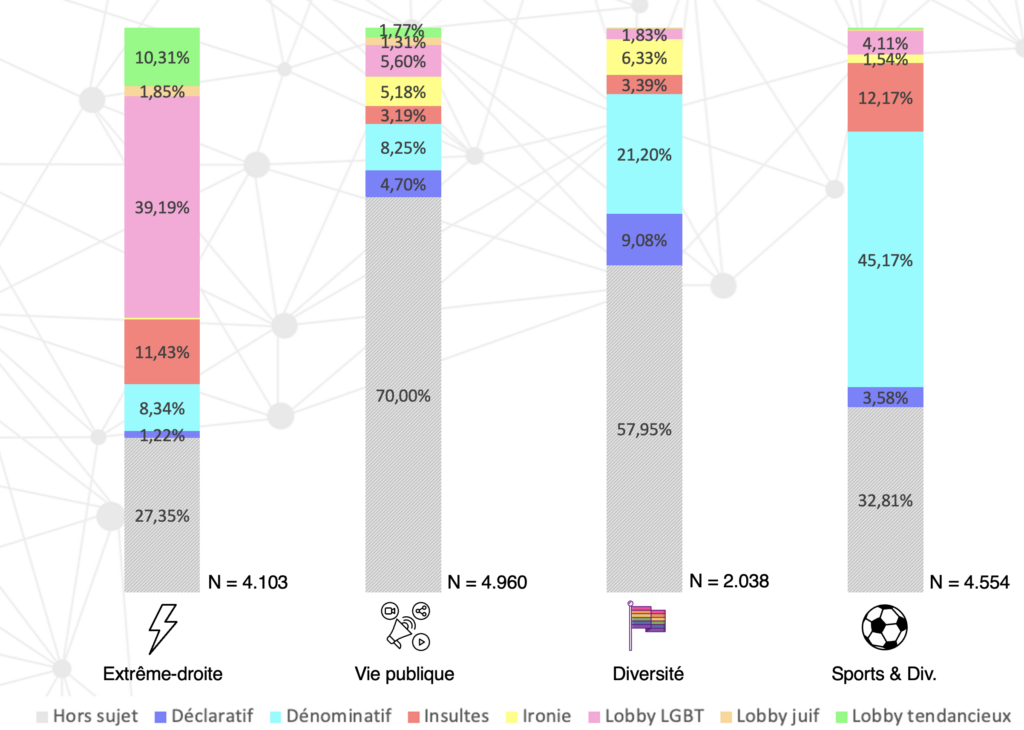

L'extrême droite et le monde du football sont clairement les plus actifs dans les sémantiques haineuses déployées. Les supporters ont développé une sémantique homophobe dans leurs commentaires de l’actualité footballistique en usant très souvent les termes « fiottes », « tapettes », et autres pour qualifier un joueur, l’adversaire, l’arbitre, etc.

C’est davantage l’influence de facteurs sociétaux (événements spécifiques, cibles politiques, appartenance à l’extrême droite ou à l’univers du football) qui semblent impacter la production de contenus haineux plutôt que le numérique comme instrument facilitateur.

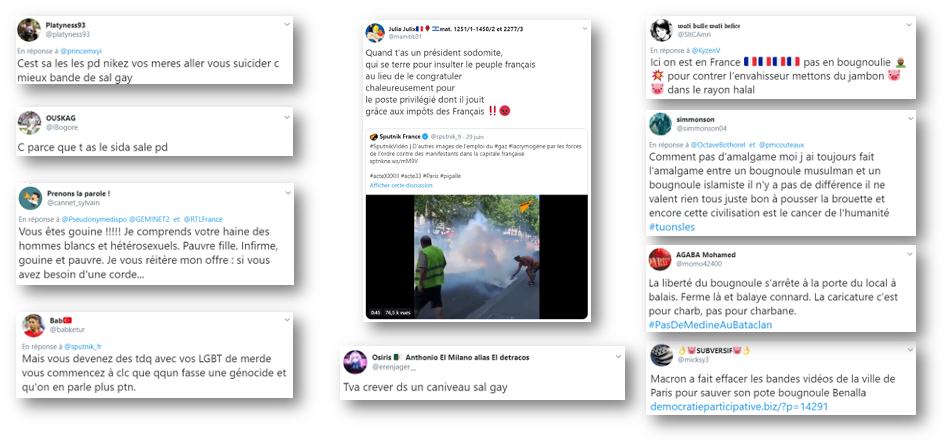

Les messages haineux sont la plupart du temps des commentaires et ont très peu de visibilité et de viralité. En un an, nous n'avons identifié que 2099 tweets qui sont clairement des insultes qui auraient du être modérées. 67 % des insultes sont des réponses à des tweets. Lorsque nous analysons ces réponses, nous découvrons que les mentions ont certaines cibles bien précises (Mbappé, Macron, Bilal Hassani, etc) Les insultes ne sont pas fortement retweetées, au contraire des témoignages comportant des insultes.

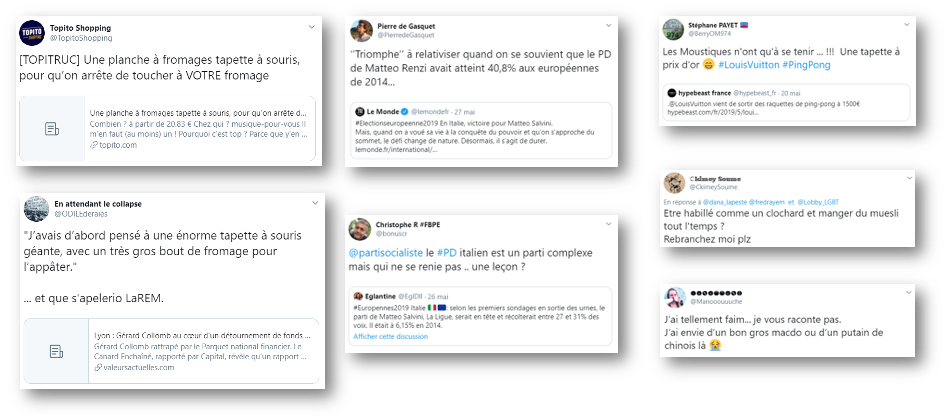

Le traitement automatique du langage est une mauvaise méthode pour identifier le contenu haineux du fait qu’il y a des problèmes sémantiques (ex: tapette à mouche), de l’ironie et une importance du contexte dans la qualification du contenu. Par ailleurs, les algorithmes de tonalité sur les insultes ont seulement identifié 11 % de contenus négatifs et même de façon erronée 4 % de contenus positifs. Le traitement manuel reste une excellente option et est possible dans la mesure où seules 2.099 insultes ont été identifiées en un an, soit une moyenne de 6 tweets haineux par jour. C'est totalement traitable à l'échelon des modérateurs de contenu. Ces modérateurs de contenu peuvent être aidés par des probabilités statistiques dans la mesure où nous avons pu identifier toute une série de métadonnées corrélées aux contenus haineux :

•L’algorithme de clustering sur base des relations entre les individus : les communautés d’extrême droite sont responsables d’une majorité d’insultes.

•Le format du tweet : 67 % des tweets sont des réponses.

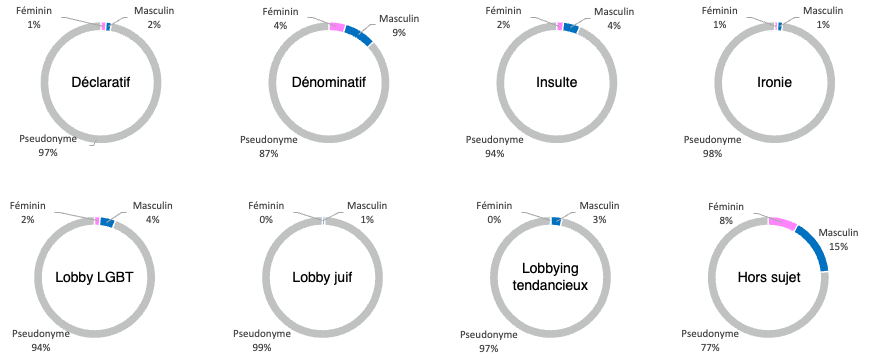

•Le fait de publier via un pseudonyme : 94 % des tweets haineux sont faits via un pseudonyme.

•Le genre masculin : sans prendre en compte les pseudonymes, 73 % des insultes proviennent de personnes de genre masculin.

•Les périodes d’événements où les minorités sont visibles médiatiquement : les pics de tweets haineux le sont autour d’événements LGBT ou catégorisé comme LGBT par les personnes qui insultent. (CF : Eurovision)

5 types de messages haineux sur Twitter

Nous avons pu isoler 5 typologies de propos haineux à l'encontre des minorités :

Insultes

Un contenu haineux attaquant une personne ou un groupe sur la base de certains attributs comme la race, l’origine ethnique, la religion, le genre ou l’orientation sexuelle. Le contenu est clairement problématique.

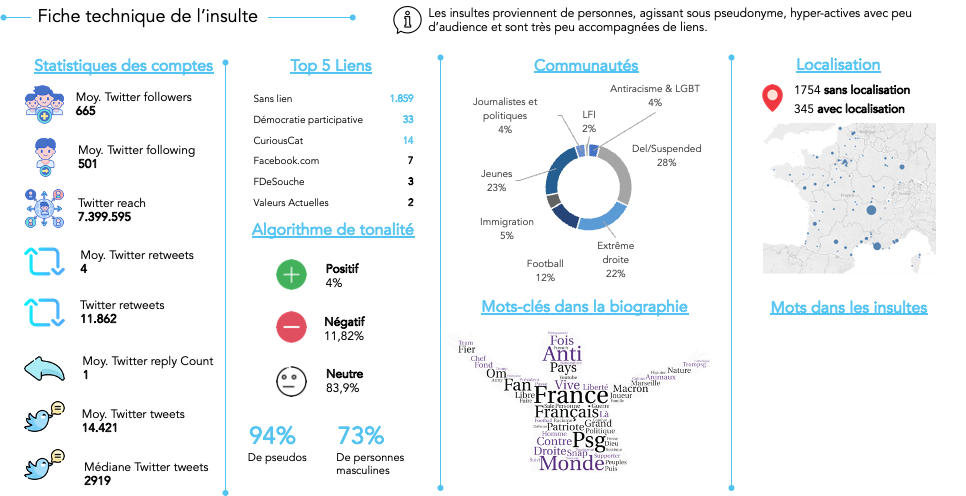

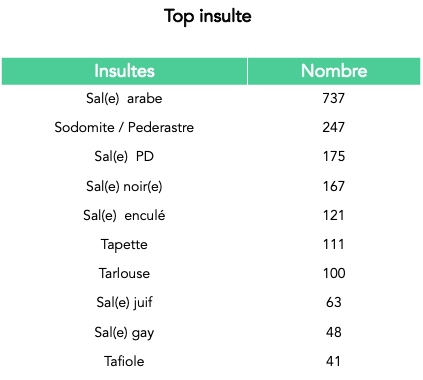

Les deux catégories les plus visées par les insultes sont les insultes envers les arabes et les homosexuels et ce alors que les mentions comprenant des insultes homophobes n’ont été analysées que sur 3 mois au lieu d’un an.

L’insulte « sale arabe » est celle qui rassemble le plus d’insultes. Vient ensuite des insultes homophobes et sur les personnes de couleur noires.

Dénominatif

Un contenu étant sémantiquement haineux sur la race, l’origine ethnique, la religion, le genre ou l’orientation, mais dont la signification dans l’usage de la personne n’est pas haineuse. On pouvait avoir comme souci l'autoqualification (une personne utilisant un propos insultant pour se définir elle-même ou son comportement) , la qualification de façon négative d'une personne, d'une organisation ou d'un événément ("quelle tapette celui-là") ou la qualification amicale avec humour d'une connaissance (« Grosse tapette » à un ami homosexuel ; « Sal arabe » à un ami d’origine arabe ; « Gros black » à un ami de couleur noire) ou des expressions courantes (« Fais pas ta tapette », « Tu joues comme une pédale »)

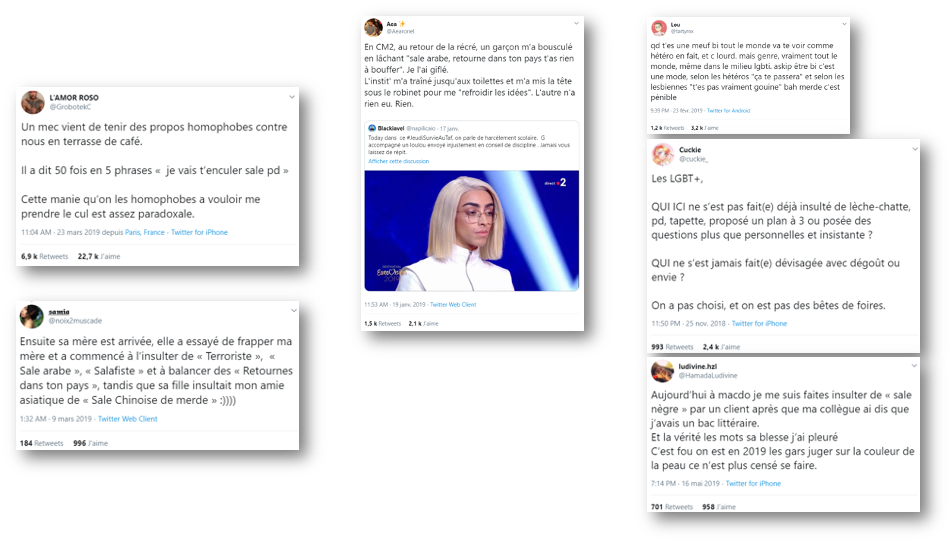

Déclaratif

Un contenu rapportant une attaque haineuse sur base de la race, de l’origine ethnique, de la religion, du genre ou de l’orientation sexuelle. Cela peut être des situations dénoncées dans l'enfance de la victime (insultes, harcèlement , agressions de la part de camarades de classe, non-réaction des professeurs et d'adultes dans ces situations, ou dénonciation du fait d'avoir été punis pour une réaction violente suite à un acte raciste ou homophobe) des situations qui se déroulent dans le moment présent (insultes, harcèlement et agressions dans l'espace public ; homophobie latente lors de repas de famille, dénonciation de remarques homophobes ou racistes de la part de policiers en exercice) ou de dénonciation non vécue personnellement.

Ironie

Un contenu étant sémantiquement haineux sur la race, l’origine ethnique, la religion, le genre ou l’orientation, mais dont l’usage est fait dans un cadre ironique. L’ironie est essentiellement utilisée avec des insultes visant des communautés spécifiques. (ethnie, orientation sexuelle, etc.) Ca peut être soit dans une optique défensive et de dénonciation (réponse à un message haineux en reprenant avec ironie les arguments insultants, utilisation avec ironie d'insultes habituellement adressées à l'encontre d'une communauté pour moquer une déclaration ou un fait) soit avec humour. (utilisation d'insultes dans une blague, utilisation avec humour d’insultes visant une communauté par une personne membre de cette dernière)

Lobbying tendancieux

Derrière l’utilisation dénominative du lobby, il y a une pensée sous-jacente qui est tendancieuse. Nous les déclinons dans l’étude. Le cas du "lobby LGBT" est intéressant dans le sens où les narratifs voguent clairement vers des logiques de complotisme

La logique est la même pour le lobby juif où le complotisme est également d'application.

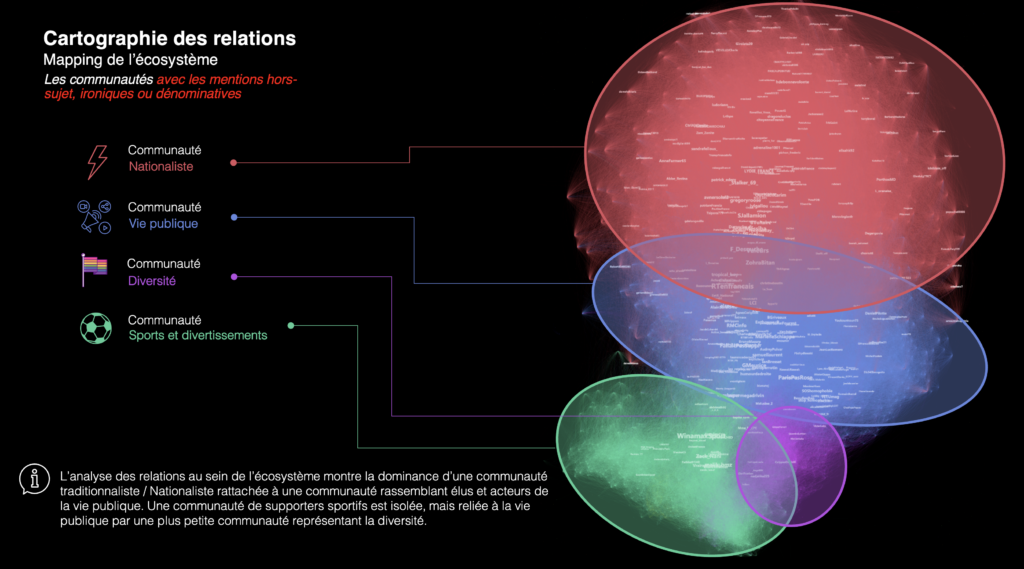

4 communautés à l'oeuvre

Dans les acteurs, les 4 communautés à l'oeuvre sont les nationalistes, la vie publique, la diversité et le sport :

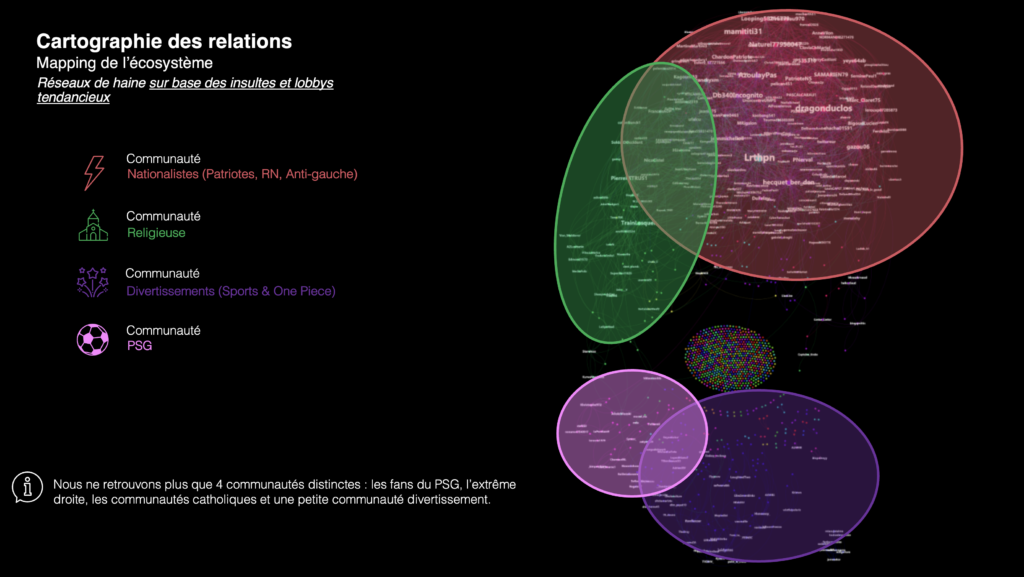

En zoomant uniquement sur ceux qui insultent réellement, on isole une communauté autour du PSG ainsi qu'une communauté de nationalistes :

L'extrême droite est en effet la communauté la plus active dans ce champs :

Les insultes les plus utilisées par les communautés sont les suivantes :

Enfin, par rapport à l'insulte, ce sont les personnes masculines et les pseudos qui ont davantage l'habitude d'insulter, même si le pourcentage de personnes masculines insultant n'est que de 4 %

Méthodologie

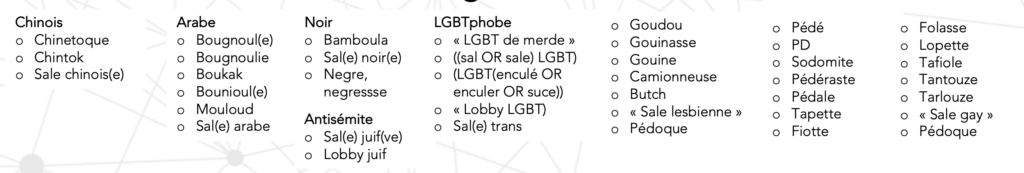

Nous avons isolé tout un certain nombre d'insultes qui rassemblaient pas moins de 140 161 tweets sur 13 mois.

Un filtre a été appliqué pour enlever les hors-sujets, les articles et les retweets ce qui ramenait à 10 861 tweets uniques. Nous avons mené ensuite toutes nos analyses sur ce corpus (comment les auteurs se suivent l'un l'autre, la typologie des tweets, et une analyse qualitative)

Pour traiter les messages de haine, il y a de nombreuses problématiques. Une qui était la plus prégnante était celle du souci sémantique avec de nombreuses mentions :

•Tapette à mouche, moustique ou souris

•Parti Démocrate (PD) italien

•Les réponses au compte @Lobby_LGBT Les restaurants chinois

Le problème de contextualisation: le mot-clé injurieux est utilisé dans un contexte non-violent (ex: chemise « Bamboula » H&M)